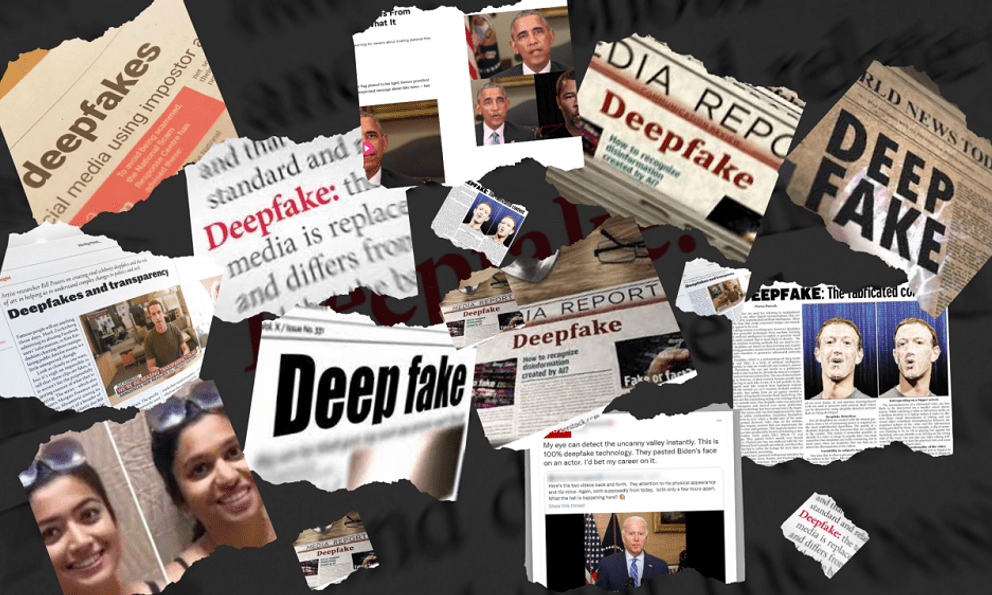

VAFC cảnh báo về hình thức tống tiền bằng Deepfake AI mới

Theo VAFC, gần đây, Trung tâm đã nhận được phản ánh từ ông QTL (HB) về việc các đối tượng sử dụng công nghệ Deepfake để thực hiện hành vi cắt ghép, phát tán các hình ảnh nhạy cảm trên mạng xã hội nhằm bôi nhọ danh dự, nhân phẩm và uy tín cá nhân của ông. Các đối tượng này sau đó đã sử dụng những hình ảnh giả mạo này để tống tiền, yêu cầu ông L chuyển tiền vào ví điện tử và liên hệ qua Email để xác nhận.

VAFC xác nhận đây là một hình thức lừa đảo sử dụng công nghệ Deepfake - công nghệ trí tuệ nhân tạo (AI) có khả năng tạo ra những video hoặc hình ảnh giả mạo vô cùng chân thực - để thực hiện hành vi phạm tội.

Theo các chuyên gia an ninh mạng, thủ đoạn của các nhóm lừa đảo này là sử dụng hình ảnh, thông tin cá nhân của nạn nhân được chia sẻ trên mạng (chủ yếu là nam giới có địa vị xã hội), sau đó sử dụng kỹ thuật cắt ghép vào các video clip nhạy cảm và nhắn tin, gọi điện đe dọa với mục đích tống tiền.

Một số nạn nhân bị các tổ chức lừa đảo giả danh là thám tử tư gọi điện thoại thông báo về việc phát hiện người này có mối quan hệ bất chính với những người phụ nữ khác. Đối tượng gửi cho nạn nhân các hình ảnh "nhạy cảm" đã được chỉnh sửa, cắt ghép với khuôn mặt của nạn nhân.

Sau đó, chúng sẽ yêu cầu nạn nhân phải chuyển một khoản tiền điện tử (USDT) với giá trị tương đương hàng tỷ đồng vào ví điện tử để không bị đăng lên mạng xã hội. Khi nạn nhân bị "sập bẫy", các đối tượng sẽ hướng dẫn mua tiền điện tử, chuyển đến các tài khoản ví điện tử theo chỉ định để chiếm đoạt.

Với sự phát triển của AI hiện nay, công nghệ Deepfake đang trở thành công cụ nguy hiểm cho tội phạm tống tiền trực tuyến. Việc dễ dàng tiếp cận công nghệ này cùng với sự gia tăng của các nền tảng mạng xã hội đã tạo điều kiện thuận lợi cho các đối tượng xấu lợi dụng để thực hiện hành vi vi phạm pháp luật.

VAFC khuyến cáo người dân nâng cao cảnh giác và thực hiện các biện pháp phòng ngừa: Cẩn trọng với những yêu cầu kết bạn từ người lạ trên mạng xã hội; Tuyệt đối không chia sẻ thông tin cá nhân, hình ảnh, video riêng tư với người không quen biết; Kiểm tra kỹ nguồn gốc thông tin, hình ảnh, video trước khi chia sẻ; Báo cáo ngay cho cơ quan chức năng khi phát hiện các trường hợp nghi ngờ lừa đảo, tống tiền bằng Deepfake.

Nếu bạn là nạn nhân của hình thức lừa đảo này, hãy: Giữ lại tất cả bằng chứng liên quan (tin nhắn, email, hình ảnh, video...); Không chuyển tiền cho kẻ tống tiền; Liên hệ ngay với cơ quan công an gần nhất để được hỗ trợ.

VAFC đang phối hợp với các cơ quan chức năng để điều tra làm rõ vụ việc của ông QTL và xử lý nghiêm các đối tượng vi phạm theo quy định của pháp luật.

Trung tâm Xử lý tin giả, thông tin xấu độc Việt Nam (VAFC) cam kết đồng hành cùng người dân trong cuộc chiến chống lại tin giả, thông tin xấu độc, góp phần xây dựng một môi trường mạng an toàn, lành mạnh.

Trước đó, rong các cảnh báo phát ra định kỳ hàng tuần về tình hình lừa đảo trực tuyến, Trung tâm Giám sát an toàn không gian mạng quốc gia - NCSC thuộc Cục An toàn thông tin (Bộ TT&TT) đã nhiều lần lưu ý việc các đối tượng sử dụng công nghệ DeepFake, DeepVoice để giả mạo cơ quan chức năng hoặc người thân của nạn nhân để gọi điện, chat hình ảnh nhằm gia tăng mức độ thành công của các vụ lừa đảo.

Cũng theo Cục An toàn thông tin, một trong những mối đe dọa lớn là tin tặc sử dụng AI để phát động các cuộc tấn công lừa đảo có mục tiêu. Tại Việt Nam, mặc dù các cơ quan, tổ chức đã triển khai nhiều giải pháp, tuy nhiên việc ứng dụng AI để tạo ra các kịch bản và tổ chức thực hiện lừa đảo trên mạng xã hội hiện khá phổ biến và nhiều người dân đã bị lừa.

![[SHOPEE] MUM’S CLUB 1 TUỔI - 1000 DEAL 1K](https://embergame.com/uploads/logo/2020/1591242455-SHOPEE-MUMS-CLUB-1-TU%E1%BB%94I-1000-DEAL-1K.png)

![[Art] Tổng hợp Fan Art của KeQuing cho anh em làm nền điện thoại](https://embergame.com/uploads/post/2020/12/18/thumb/1608286069-art-tong-hop-fan-art-cua-kequing-cho-anh-em-lam-nen-dien-thoai.jpg)

Bình Luận